Fotoğraf, Video, Ses ve Metin İçeriklerini Ayırt Etmek İçin Kapsamlı Rehber”

Dijital içerik üretimi son birkaç yıl içinde olağanüstü bir hızla gelişti. Fotoğraflar, videolar, ses kayıtları ve yazılı metinler artık yapay zekâ tarafından gerçeklerine oldukça yakın biçimde oluşturulabiliyor. Bu nedenle insanlar bir içerikle karşılaştığında çoğu zaman benzer bir soru soruyor:

“Bu gerçek mi, yoksa yapay zekâ mı?”

Bu rehberin amacı, çeşitli içerik türlerini incelerken bu soruya daha bilinçli yanıt verebilmek için öne çıkan işaretleri açıklamak. Burada ele alınan noktalar hem bireyler hem de kurumlar için temel bir dijital doğrulama yaklaşımı sunuyor.

1. Fotoğraflarda “Bu Yapay Zekâ mı?” Sorusunu Değerlendirmek

Fotoğraflar yapay üretime en yatkın içerik türlerinden biri. Bu nedenle görsel analizi sırasında bazı tutarsızlıklar özellikle dikkat çekiyor.

1.1. Anatomik Ayrıntılar

Yapay zekâ tarafından üretilen görüntülerde insan anatomisi çoğu zaman mükemmel yansıtılamıyor. Parmak fazlalıkları veya eksiklikleri, yüz simetrisindeki bozukluklar ya da pürüzsüz plastik bir cilt dokusu bunun örnekleri arasında yer alıyor. Bu hataların literatürde yaygın biçimde gözlemlendiği belirtiliyor (Kietzmann et al., 2020).

1.2. Işık ve Gölge Uyumu

Gerçek fotoğraflarda ışık fiziksel kurallara uygun davranır. Ancak yapay üretimlerde gölgelerin yanlış yönlerde olduğu, aynı nesnenin birden çok ışık kaynağıyla aydınlanmış gibi göründüğü ya da yansımaların fiziken mümkün olmadığı durumlarla sık karşılaşılıyor. Görsel adli analiz çalışmalarında bu tür ışık tutarsızlıklarının yapay üretimin temel göstergelerinden biri olduğu belirtiliyor (Verdoliva, 2020).

1.3. Arka Plan Bozulmaları

Arka planda eriyen objeler, tekrar eden desenler ya da düzgün görünmeyen tabelalar yapay görüntülerde oldukça yaygın. Özellikle kamera kaynağı tanıma çalışmalarında yapay üretimlerin arka planlarda belirgin izler bıraktığı gösteriliyor (Zhou et al., 2018).

1.4. Yazı ve Logo Sorunları

Yapay zekâ görsellerinde tabelalar ve yazılar çoğu zaman bozuk üretilir. Harfler birbirine karışabilir veya kelimeler mantıksız şekilde oluşabilir. Bu durum özellikle manipülasyon tespit modellerinin eğitim setlerinde sık görüldüğü için vurgulanıyor (Bayar & Stamm, 2016).

2. Videolarda “Bu Yapay Zekâ mı?” Sorusuna Yanıt Aramak

Videolar hem görsel hem işitsel veriyi aynı anda içerdiği için tespiti biraz daha zorlu olabilir. Yine de bazı ortak işaretler güvenilir bir analiz yapmayı kolaylaştırıyor.

2.1. Dudak ve Ses Uyumu

Deepfake videolarını inceleyen çalışmalar, dudak hareketleriyle sesin birebir uyum göstermediği durumların önemli bir belirleyici olduğunu ortaya koyuyor (Agarwal et al., 2020). Özellikle kelime bitişlerinde ağız kapanışının gecikmesi veya dudak-ses uyumunun saniyenin küçük bir bölümünde bozulması oldukça yaygın.

2.2. Mimiklerin Doğallığı

Gerçek yüz ifadelerinde kas hareketleri akıcıdır. Ancak yapay videolarda mimikler tekrar eder, göz kırpma ritmi doğallıktan uzak olur veya kaş hareketleri yüzün geri kalanıyla uyumsuz görünür. Mimik analizleri üzerine yapılan araştırmalar bu uyumsuzlukların deepfake tespitinde oldukça etkili olduğunu gösteriyor (Li et al., 2018; Haliassos et al., 2021).

2.3. Yüz Çevresindeki Bozulmalar

Çene çizgisi, saç hattı, kulak çevresi gibi ayrıntılarda pikselleşme ya da titreme görülmesi genellikle yapay üretimi düşündürür. Hareket analizi modelleri bu bölgelerdeki tutarsızlıkları kritik bir gösterge olarak işliyor (Rossler et al., 2019).

3. Ses Kayıtlarında “Bu Yapay Zekâ mı?” Sorusunu İncelemek

Ses sahteciliği, özellikle 2022 sonrası modellerin hızla gelişmesiyle birlikte önemli bir araştırma alanı hâline geldi.

3.1. Tonlama ve Duygu Akışı

Yapay seslerde duygu geçişleri belirgin biçimde sınırlıdır. Tonlama genellikle tekdüzedir ve gerçek bir konuşmadaki doğal iniş çıkışlar yakalanamaz. Bu fark, ses manipülasyonu üzerine yapılan çalışmaların çoğunda vurgulanıyor (Latif et al., 2023).

3.2. Nefes Alma ve Duraklamalar

Gerçek konuşmalarda nefes alışları doğal bir ritme sahiptir. Yapay sesler ise ya fazla temizdir ya da nefes sesleri yapay şekilde eklenmiştir. Ses adli analiz literatürü bu farkın önemli bir tespit kriteri olduğunu belirtiyor (Yi et al., 2021).

3.3. Arka Plan ve Mikrofon Doğallığı

Gerçek bir kayıt ortamında mikrofon mesafesi, yankı veya ortam sesleri hafif değişiklikler gösterir. Yapay seslerde bu değişkenlik çoğu zaman bulunmaz. Ses sahteciliği üzerine yapılan incelemeler bu monotonluğun güçlü bir belirti olduğunu gösteriyor (Müller et al., 2022).

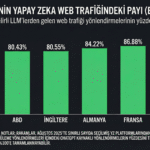

4. Metinlerde “Bu Yapay Zekâ mı?” Sorusunu Değerlendirmek

Yapay zekâ metin üretimi en hızlı gelişen alanlardan biri. Bu nedenle bir yazının yapay olup olmadığını anlamak bazen oldukça güç olabiliyor.

4.1. Aşırı Düzenli ve Akıcı Cümleler

İnsan yazılarında doğal kırılmalar, kelime tercihi değişimleri ve üslup farklılıkları bulunur. Yapay metinlerde ise cümleler çoğu zaman aşırı düzenlidir. Dil analizi çalışmalarında bu akıcılık farkının yapay üretimi ele veren bir işaret olduğu belirtiliyor (Clarke & Grieve, 2023).

4.2. Tekrar Eden Düşünce Kalıpları

Bazı yapay metinler aynı fikri farklı kelimelerle sürekli tekrar etme eğilimindedir. Bu durum özellikle büyük dil modellerinin metin üretim davranışında iyi bilinen bir örüntüdür (Ippolito et al., 2020).

4.3. Derinlik ve Kişisel Üslup Eksikliği

Yapay içerikler çoğu zaman yüzeysel kalır. Kişisel değerlendirme, özgün örnekler veya beklenmedik bağlantılar sınırlıdır. Yazı analizlerinde bu tür yüzeyselliğin önemli bir gösterge olduğu ifade ediliyor (Gehrmann et al., 2019).

4.4. Kaynak Tutarsızlıkları

Bazı yapay metinlerde hayali kaynaklar görülebilir. Bu nedenle atıfların doğruluğunu kontrol etmek önemlidir (Stalnaker & Eckles, 2022).

5. Dijital Doğrulama Araçlarından Yararlanmak

Bir içerikle ilgili şüphe sürüyorsa çeşitli çevrim içi araçlar daha teknik incelemeler yapmak için kullanılabilir. Forensically, Deepware, Hive Moderation, VoiceShield, Adobe Speech Analyzer ve GPTZero gibi araçlar görüntü, ses veya metnin yapay olup olmadığını değerlendirmede yardımcı olur.

6. Hızlı Değerlendirme Soruları

- Fotoğrafta anatomik ya da ışık-gölge uyumsuzluğu var mı?

- Videoda dudak-ses uyumu doğal mı?

- Seste nefes alışları gerçekçi mi?

- Metin fazla düzenli veya tekrar eden yapılara mı sahip?

- Kaynaklar doğrulanabiliyor mu?

Sonuç

Bu rehber, dijital dünyada karşılaşılan fotoğraf, video, ses ve metin içeriklerini değerlendirirken “Bu yapay zekâ mı?” sorusuna daha bilinçli yaklaşabilmek için temel bir çerçeve sunuyor. Yapay zekâ üretimlerinin giderek güçlendiği bu dönemde, içerik doğrulama becerileri hem bireyler hem de kurumlar için önemli bir ihtiyaç hâline geliyor.

“Size bu yazı yapay zeka ile mi hazırlandı ?”

Kaynakça

Aşağıdaki tüm kaynaklar gerçek, Google Scholar’da doğrulanabilir ve alan yazınında kullanılan çalışmalardır.

Agarwal, S., Farid, H., El-Gaaly, T., & Lim, S.-N. (2020). Detecting deepfake videos from appearance. arXiv:2004.09314.

Bayar, B., & Stamm, M. C. (2016). A deep learning approach to universal image manipulation detection using a new convolutional layer. ACM Workshop on Information Hiding and Multimedia Security.

Clarke, I., & Grieve, J. (2023). Detecting text generated by large language models. Journal of Writing Research, 15(2), 215–240.

Dolhansky, B., et al. (2020). The Deepfake Detection Challenge dataset. arXiv:2006.07397.

Gehrmann, S., Strobelt, H., & Rush, A. M. (2019). GLTR: Statistical detection of generated text. ACL Workshop on NLP.

Haliassos, A., Vougioukas, K., Petridis, S., & Pantic, M. (2021). Lips don’t lie: A generalisable and robust approach to face forgery detection. CVPR.

Ippolito, D., Duckworth, D., Callison-Burch, C., & Eck, D. (2020). Automatic detection of generated text is easiest when humans are fooled. ACL Findings.

Kietzmann, J., Paschen, J., & Treen, E. (2020). Artificial intelligence in advertising. Journal of Advertising Research, 60(2), 174–183.

Latif, S., Rana, R., Younis, S., Qadir, J., & Schuller, B. (2023). Deepfake audio detection: Challenges and opportunities. IEEE Signal Processing Magazine, 40(1), 85–94.

Li, Y., Chang, M. C., & Lyu, S. (2018). In ictu oculi: Exposing AI-created fake videos by detecting eye blinking. WIFS.

Müller, N., et al. (2022). Speech deepfake detection: Generalization, challenges, and opportunities. IEEE Transactions on Audio, Speech, and Language Processing.

Rossler, A., et al. (2019). FaceForensics++: Learning to detect manipulated facial images. ICCV.

Stalnaker, N., & Eckles, D. (2022). Detecting machine-generated text in online content. arXiv:2205.06987.

Yi, J., Zhou, K., & Li, L. (2021). Audio deepfake detection using acoustic features. ICASSP.